마이크로소프트(MS)와 손잡은 오픈AI의 챗GPT, 구글 람다 등 빅테크 대형언어모델(LLM)이 경쟁하는 가운데 소형언어모델(sLLM) 출시 행렬도 이어지고 있다. 소형언어모델은 파라미터(매개변수가) 대형에 비해 적지만 훈련 및 운영 비용 부담 또한 낮다. 또한 LLM과 달리 오픈소스로 공개해 누구나 무료로 사용할 수 있다는 장점도 있다. 빅테크 간 LLM 기술 경쟁과 함께 소형언어모델과의 주도권 경쟁도 뜨거워질 것이라는 전망이 나온다.

언어 모델의 크기를 결정하는 파라미터는 오픈AI GPT-3.5의 경우 1750억개, 구글 람다는 1370억개에 달한다. 이에 비해 소형언어모델은 파라미터가 수십억 내지 수백억대로 상대적으로 적다. 소형언어모델은 미세조정 과정을 통해 다른 LLM의 성능을 따라잡을 수 있도록 한 것이 특징이다. 훈련 및 운영 비용도 저렴해 적은 부담으로 활용할 수 있다는 장점이 있다.

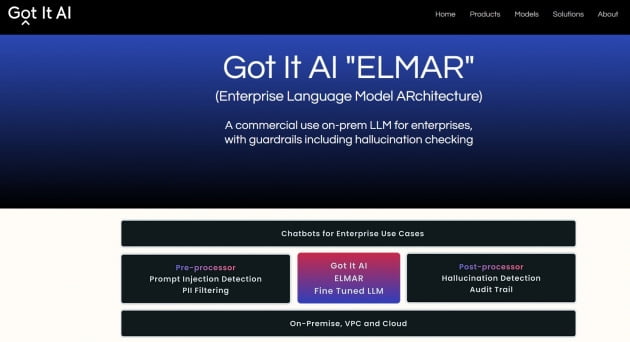

스테이블LM에 앞서 스탠포드대학교 연구진의 ‘알파카’, 데이터브릭스 ‘돌리’, 갓잇AI의 ‘엘마’ 등이 출시됐다. 파라미터 규모가 70억개인 알파카의 경우, 컴퓨터 8대를 이용해 3시간 만에 훈련을 끝냈다. 훈련비용은 600달러(약 80만원) 정도다. 오픈AI의 GPT-3는 훈련비용으로 1000만달러(약 132억원)이 투입된 것으로 알려져 있다.

스탠포드 연구진은 알파카의 성능을 측정한 결과 기대 이상이라고 평가했다. 이메일이나 소셜 미디어의 글 작성, 생산성 도구 등에서 알파카는 90개 항목, GPT는 89개 항목에서 성능이 상대보다 앞섰다는 것이다. 하지만 소형언어모델의 경우 미세조정을 해주지 않으면 성능이 크게 떨어지는 현상도 보였다.

갓잇AI의 엘마는 클라우드를 활용하지 않는 온프레미스(사내구축형)를 겨냥한 모델이다. 피터 레란 갓잇AI 회장은 “모든 기업이 크고 강력한 모델이 필요한 것은 아니다”라며 “데이터가 외부로 반출되는 것을 원하지 않는 기업도 많다”고 설명했다. 보유한 데이터를 활용해 맞춤형 언어 모델을 구축하려는 기업들도 있다는 것이다.

GPT-4 기반 생성AI 모델도 쏟아져 나오고 있다. 이 중 가장 주목받고 있는 건 오토GPT다. AI 스타트업 시그니피컨트그래비타스가 지난달 말 내놓은 오토GPT는 최종 목표만 설정해 놓으면 스스로 목표 달성을 위한 작업을 수행해 결과를 내놓는다. 챗GPT를 사용할 때 사람이 직접 입력해야 하는 프롬프트(지시어)를 스스로 생성할 수 있다는 것이다.

예를 들어 오토GPT를 요리사라고 설정하고 “부활절과 같은 특정 기념일에 사용할 독창적인 레시피를 만들어달라”고 명령하면 오토GPT가 직접 레시피를 찾기 위해 검색하고, 시행착오를 거치는 ‘자율반복’ 과정을 통해 새로운 레시피를 내놓는 작업을 수행할 수 있다. 이를 두고 일각에선 오토GPT가 범용인공지능(AGI)과 가장 가깝다는 평가도 나온다. 반면, 지나친 기대감은 섣부르다는 평가도 있다. 엔비디아에서 AI를 연구하는 짐 판 리서치 과학자는 “오토GPT가 간단한 특정 작업은 잘 해결할 수 있지만, 어려운 작업의 경우 신뢰할 수 없었다”라며 “중요하고 복잡한 의사결정을 안정적으로 해결하는 것은 불가능하다”고 지적했다. LLM과 이를 기반으로 개발한 생성AI 모델들이 계속 등장하는 상황에서 개인정보유출 등 다양한 부작용이 우려되는 만큼 이에 대한 적절한 통제가 필요하다는 의견도 있다.

업계에선 빅테크 간 LLM 경쟁과 함께 LLM과 sLLM 간 영역 싸움도 갈수록 치열해질 것으로 보고 있다. 폐쇄형인 LLM과 오픈소스를 강점으로 내세운 sLLM 진영이 시장의 주도권을 놓고 경쟁한다는 것이다.

최진석 기자 iskra@hankyung.com

관련뉴스