딥러닝 기반 초해상화 비디오 스트리밍 기술 개발

(대전=연합뉴스) 이재림 기자 = 한국과학기술원(KAIST)은 전기및전자공학부 신진우·한동수 교수 연구팀이 열악한 인터넷 환경에서도 끊김 없이 비디오를 전송할 수 있는 기술을 개발했다고 30일 밝혔다.

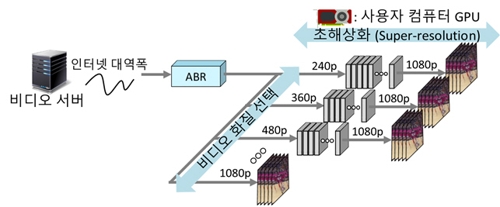

이 기술은 딥러닝 기술인 심층 콘볼루션 신경망(CNN) 기반 초해상화를 적응형 스트리밍(HTTP adaptive streaming) 비디오 전송기술과 접목한 방식이다.

적응형 스트리밍은 유튜브나 넷플릭스 등에서 동영상을 사용자에게 전송할 때 쓰는 보편적인 형태다.

기존 적응형 스트리밍은 시시각각 변하는 인터넷 대역폭에 맞춰 비디오 화질을 조절한다.

이를 위해 다양한 알고리즘이 연구되고 있는데, 네트워크 환경이 좋지 않을 때는 고화질로 동영상을 볼 수 없다는 한계가 있다.

이는 긴 영상을 짧은 시간의 여러 비디오 조각으로 나눠 보내는 방식을 쓰기 때문이다.

동영상을 제공하는 서버에서는 비디오를 미리 일정 시간 길이로 나눠 준비해놓는다.

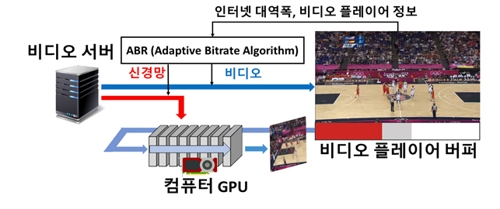

연구팀이 새로 개발한 시스템은 여기에 더해 신경망 조각을 비디오 조각과 같이 다운받게 했다.

제일 큰 신경망 크기는 2MB 정도다.

신경망의 일부만 내려받아도 초해상화 기술을 이용할 수 있도록 설계했다.

사용자 컴퓨터에서는 초해상화 기술을 사용해 비디오 플레이어 버퍼에 저장된 저화질 비디오를 고화질로 바꾼다.

모든 과정은 실시간으로 이뤄진다.

이를 통해 사용자들은 고화질의 비디오를 시청할 수 있게 된다.

최대 26.9%의 적은 인터넷 대역폭으로도 체감 품질(QoE·기댓값에 맞춰 주관적으로 평가하는 허용도)을 제공할 수 있다고 연구팀은 설명했다.

아울러 같은 인터넷 대역폭이 주어진 경우에는 최신 적응형 스트리밍보다 체감 품질이 평균 40% 높다고 덧붙였다.

한동수 교수는 "딥러닝 방식을 이용해 기존 비디오 압축 방식보다 더 많은 압축을 이뤄낸 것"이라며 "지금은 데스크톱에서만 구현했지만, 앞으로는 모바일 기기에서도 작동할 수 있도록 발전시켜 나갈 것"이라고 말했다.

연구는 과학기술정보통신부 정보통신기술진흥센터(IITP) 방송통신연구개발 사업 지원을 받아 수행했다.

여현호·정영목·김재홍 학생이 함께한 성과는 지난 10일 '유즈닉스 OSDI'(USENIX OSDI)에서 발표됐다.

연구팀은 아울러 국제 특허 출원도 마쳤다.

walden@yna.co.kr

(끝)

<저작권자(c) 연합뉴스, 무단 전재-재배포 금지>

관련뉴스